作者:Doug Petkanics,Livepeer CEO;翻譯:0xxz@喜來順財經

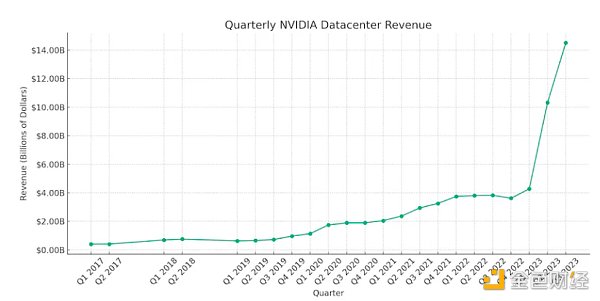

當人們發現 Livepeer 網絡有數千個 GPU 活躍地用于每周轉碼數百萬分鐘的視頻時,最常見的問題之一是這些 GPU 是否可以用于執行其他類型的計算。特別是,隨著 2023 年人工智能的興起,以及對 GPU(用于執行人工智能訓練和推理的硬件)需求的相關增長,人們自然會認為 Livepeer 網絡可以利用其算力進軍到人工智能基礎設施上,人工智能基礎設施花費數十億美元。NVidia 的數據中心業務為 AI 計算提供 GPU,僅上個季度就實現了 140 億美元的收入增長,高于去年同期的 40 億美元。

資料來源:NVidia 季度報告,來自 X 上的@Thomas_Woodside

那些做出這些假設的人是正確的——Livepeer 網絡當然可以被那些尋求具有顛覆性成本的人工智能處理的人使用。隨著近幾個月通過Livepeer Studi實現的 Livepeer 視頻使用量的增長以及新社區管理的 Livepeer 金庫的推出,奠定了基礎,現在是時候將 AI 視頻計算功能引入Livepeer了。

本文下面部分將闡述如何在Livepeer網絡上引入人工智能視頻計算,以及使其成為現實的計劃、策略和時間表。

Livepeer 始終致力于其使命:構建世界開放視頻基礎設施。其他計算平臺試圖成為通用的“區塊鏈上的 AWS”或“運行任何類型的計算任務”類型的市場,但由于缺乏針對行業的解決方案的能力,這給市場進入帶來了挑戰部分。相反,Livepeer 通過轉碼專注于視頻計算,并能夠為特定行業(超過1000億美元的視頻流市場)構建有針對性的產品和 GTM,以解決實際用例并挖掘現有需求,而不是營銷沒有人想要的通用的抽象解決方案。

對視頻的關注意味著 Livepeer 避免過度反應并轉向 ICO、NFT 或 DeFi 等最新熱門趨勢,而是始終詢問這些創新如何應用于視頻。高點沒有那么高,但更重要的是,低點也沒有那么低。這也吸引了一個以任務為中心的團隊和社區,擁有深厚的視頻專業知識,他們對我們在很長一段時間內所做的事情感到興奮,而不是當本月的趨勢失去動力時離去的社區。

目前,沒有什么趨勢比人工智能的快速崛起更熱門了。但與許多加密貨幣團隊和項目不同的是,Livepeer 并沒有放棄其使命并“轉向人工智能”。相反,我們提出了這樣的問題:人工智能將如何影響視頻的未來。人工智能在很多方面降低了視頻創作者的門檻。兩個重要的因素是首先減少創作的時間和成本,以及減少高質量視頻制作和輸出的時間、成本和專業知識。

在創作方面,生成式人工智能可用于根據文本或圖像提示創建視頻剪輯。過去,設置場景需要攝制組、布景、攝像機、腳本、演員、編輯等,現在可能只需要用戶在鍵盤上輸入文本提示,然后等待幾分鐘,讓 GPU 生成樣本潛在的結果。生成視頻不會取代高質量的作品,但它可以在流程的各個階段節省大量成本。

在制作方面,無論是由人工智能創建還是由創作者提交,諸如升級、幀插值、字幕生成等功能都可以快速提高視頻內容的質量和可訪問性。視頻中的交互性等高級功能可以通過自動對象檢測、屏蔽和場景類型分類來啟用。

Livepeer 利用這一 AI 功能集的時機令人興奮,因為最近發布了開源基礎模型,包括?Stable Video Diffusion、ESRGAN、FAST 等,這些模型都與閉源專有模型保持同步。其目標是讓世界上的開放視頻基礎設施支持運行所有人都可以訪問的開源模型,這些模型現在已經存在,并且由于開源人工智能社區的創新而快速變得更好。

人工智能生命周期有很多階段,但通常需要大量計算能力的三個階段是訓練、微調和推理。簡而言之:

訓練需要創建模型并在非常大的數據集上運行計算。有時,這需要在訓練基礎模型(例如通過 OpenAI 或 Google 訓練的模型)時進行價值數千或數億美元的計算。

微調更具成本效益,并且采用現有的基礎模型,但根據特定任務的一組特定輸入來調整權重。

推理是采用已經訓練和調整的模型,并讓它產生輸出或根據輸入集進行預測的行為。對于一個推理作業,相對于前兩個階段,這在計算方面通常很便宜,但通常會一遍又一遍地執行數百萬次,因此推理的花費超過了訓練的成本,因此證明訓練投資的合理性。

訓練和微調需要訪問大型數據集和密集聯網的 GPU,以便它們能夠相互通信并快速共享信息。像 Livepeer 這樣的網絡不太適合開箱即用的訓練,并且需要進行重大更新才能完成任務。雖然去中心化網絡作為專有大型技術訓練云的替代品對于訓練來說很有吸引力,但由于網絡開銷和訓練基礎模型時的低效率,從成本角度來看,去中心化網絡是否具有競爭力是值得懷疑的。

另一方面,推理是像 Livepeer 這樣的去中心化網絡可以發揮作用的地方。每個節點運營商都可以選擇將給定模型加載到其 GPU 上,并且可以在成本上進行競爭,以根據用戶輸入執行推理作業。就像在 Livepeer 轉碼網絡中一樣,用戶可以向 Livepeer 網絡提交作業來執行 AI 推理,并且應該獲得公開市場競爭定價的好處,可以利用當前閑置的 GPU 功率,從而看到成本效益。

GPU 是人工智能熱潮的命脈。NVidia 的數據中心業務以 GPU 需求為基礎,在過去一年呈指數級增長。埃隆·馬斯克 (Elon Musk) 開玩笑地表示,GPU 比毒品更難買到。然而,像 Livepeer 這樣的 DePIN 網絡已經表明,通過其開放的市場動態,以及通過通脹代幣獎勵來引導激勵,它們可以在需求之前吸引全球 GPU 供應,從而可以彈性地支持新用戶和應用程序的增長。近乎無限的即用即付容量。開發人員不再需要以高價提前預留不使用時閑置的硬件,而是可以按盡可能低的市場價格付費。這是去中心化網絡推動人工智能繁榮的巨大機會。

讓連接到 Livepeer 的1000個GPU 發揮作用

GCP 或 AWS 等云提供商允許你在其企業云上“預留 GPU 服務器”。像 Akash 這樣的開放網絡更進一步,讓你可以從世界各地的眾多去中心化提供商之一按需租用服務器。但無論上述選擇如何,你都必須管理租用的服務器來運行模型并執行任務。如果你想構建一個可以同時執行多個任務的應用程序,則必須對其進行擴展。你必須將工作流程鏈接在一起。

Livepeer 將事物抽象為“工作”,你可以將其提交到網絡并相信它會完成。Livepeer 已經通過視頻轉碼實現了這一點,其工作是提交一段 2 秒的視頻片段進行轉碼。你只需將作業發送到網絡,并且可以確信你的廣播節點將可靠地完成該作業,并負責工作節點選擇、故障轉移和冗余。

對于人工智能視頻計算任務,它可以以同樣的方式工作。可能有一個“從文本生成視頻”的工作。你可以相信你的節點將完成此任務,并且你可以將其擴展到你想要通過單個節點同時提交的任意數量的作業,該節點可以利用數千個 GPU 的網絡來執行實際計算。向前邁出一步 - 這仍然處于設計階段 - 你可以提交整個工作流程,例如

從文本生成視頻

升高一級

進行幀插值使其播放流暢

網絡可以為你做到這一點,而你無需將單獨的模型部署到單獨的機器、管理 IO、共享存儲等。不再需要管理服務器、擴展服務器、進行故障轉移等。Livepeer 是一個可擴展的基礎設施,具有最大的成本效益且高度可靠。如果網絡能夠兌現人工智能視頻計算的這些承諾,就像它在視頻轉碼工作中所做的那樣,它將提供新水平的開發人員體驗和成本降低,這是開放人工智能世界中尚未見過的。

與Livepeer過去7年的歷程一致,該項目將致力于展示真實的、可用的、功能性的、開源的軟件和網絡能力,然后再進行“Livepeer有這個”的宣傳。以下是實現這一目標的計劃的簡短版本:

為其他作業類型選擇特定的初始用例,而不僅僅是視頻轉碼:基于 AI 的生成視頻,由 AI 升級和幀插值支持。偉大的開放模型,例如Stable Video Diffusion,在這個領域每天都在不斷發展。

通過在節點軟件的分叉/尖峰內構建來快速行動,將這些功能添加到我們的協調器(供應方)節點和廣播器(需求方)節點。Livepeer 的開放媒體服務器 Catalyst 應支持用于請求和使用這些生成視頻任務的接口。

運行此峰值的用戶將在 Livepeer 上形成某種子網絡,但他們將使用 Livepeer 協議來發現并向通過 Livepeer 主網運行此新功能的節點付款。

與面向消費者的前端應用程序合作,利用 Livepeer 極具成本效益的開放計算網絡,并捕獲和展示驗證 Livepeer 相對于公共云的成本效益的數據。

在我們驗證這一點后,合并到核心 Livepeer 客戶端,添加其他工作類型,并圍繞利用其他形式的基于 AI 的視頻計算來發展生態系統。

AI 視頻子網絡節點與轉碼節點一起運行,同時使用 Livepeer 主網支付。

Livepeer 最近通過其Delta 升級向該協議引入了一個由鏈上金庫管理的社區,并且幾個月來一直在使用 LPT 來資助公共產品計劃。目前已經有一項預提案正在討論中并接近投票,該提案旨在資助一個特殊目的實體(或 SPE),該實體致力于使人工智能視頻計算前景成為現實。第一個提案旨在實現核心開發,以完成上面列出的前 4 項任務,包括:

將這些 AI 功能開發為 Livepeer 節點分叉

節點運營商可以形成一個子網絡,通過在 Livepeer 主網上支付來執行這些任務。

一個向消費者展示這些功能的前端應用程序。

基準和數據的集合,顯示 Livepeer 網絡大規模執行人工智能推理的成本效益。

它還提出了未來潛在的融資里程碑,即從金庫提供基礎設施信貸,以支付該數據收集期間消費者使用的初始成本。

Livepeer Discord 中的 #ai-video 頻道已成為圍繞該計劃進行討論和合作的熱點,任何相信開放 AI 基礎設施和視頻 AI 計算未來的人都應該過來打個招呼并參與其中。節點運營商已經開始對不同的硬件進行基準測試,熟悉運行這些開放視頻模型,并解決從視頻轉碼專業轉向其他視頻特定作業類型的挑戰。成為一個快速發展的項目團隊的一員是一段有趣的時光。

雖然這個最初的里程碑可以表明 Livepeer 對于支持的特定形式的 AI 視頻計算具有成本效益,但真正的終極力量在于 AI 開發人員能夠 BYO 模型、BYO 權重、BYO 微調或部署自定義LoRA 建立在網絡現有基礎模型之上。

支持這些初始功能,跨越一組不同的模型和計算形式,將導致節點操作、GPU 上的模型加載/卸載、節點發現和協商、故障轉移、支付、驗證等領域的快速學習當談到人工智能視頻計算時。從那里,我們可以評估 Livepeer 網絡上生產和支持任意 AI 視頻計算作業類型的未來里程碑。

早期,視頻特定平臺(例如 Livepeer Studio)可以為視頻開發人員構建 API 和產品,以利用支持的模型。消費者應用程序(例如 AI Video SPE 中提出的應用程序)可以通過 Catalyst 節點直接在 Livepeer 網絡上使用這些功能。但隨著這些功能的擴展,以創作者為中心的新人工智能業務可以形成,并利用 Livepeer 的全球 GPU 網絡,以經濟高效的方式構建定制體驗,而無需依賴昂貴的大型技術云及其專有模型作為業務支柱。

這是一條令人興奮的道路,需要跑才能到達那里。毫無疑問,人工智能將在未來幾年以超乎我們想象的速度改變視頻世界,我們期待世界的開放視頻基礎設施成為未來實現這一大膽新技術所需的所有計算的最具成本效益、可擴展性和可靠的骨干網。